想象一下,你正看着一场虚拟直播,屏幕里的虚拟主播虽动作灵动,却总觉得隔着一层纱,少了点人情味。就在这时,主播突然因为你的一句调侃而露出“无奈”的表情,或者因为一片支持的弹幕而“眼眶微红”。这并非魔法,而是情感识别技术正悄然改变着我们与虚拟世界的互动方式。虚拟直播不再是单向的表演,它开始能“感受”到我们的情绪,并作出贴心的回应。这种结合,正是下一代沉浸式体验的核心,其目标直指一个词:优化。优化交流的深度,优化情感的共鸣,最终优化每一位屏幕前用户的参与感和满意度。作为全球实时互动服务的基石,声网一直致力于通过卓越的技术让互动更真实、更自然,而情感识别与虚拟直播的结合,正是这一愿景下的重要实践。

情感识别:让虚拟形象“活”起来

情感识别技术,简单来说,就是让计算机能够看懂人的喜怒哀乐。它通过分析用户传来的音频、视频流,甚至是文本内容,来识别出其中蕴含的情感状态。这项技术对于虚拟直播而言,如同为其注入了灵魂。

传统的虚拟主播互动,大多依赖于预设的脚本或操作者的手动控制,反应难免滞后和模式化。而结合了情感识别技术后,虚拟形象能够实时感知观众的情绪。例如,当系统检测到大量观众发送的弹幕中充满“哈哈哈”等快乐词汇时,虚拟主播可以自动触发一个开心的舞蹈动作;反之,当检测到观众表达困惑或提问时,主播则可以做出思考或耐心解释的姿态。研究人员指出,这种基于实时情感反馈的互动,能够显著提升用户的社会临场感,即感觉自己在与一个“真实”的个体进行交流,而非一个冰冷的程序。

更进一步,情感识别可以实现个性化的情感回应。系统可以不仅识别出整体直播间的情绪氛围,还能对个别用户的特殊情感表达做出反应。比如,一位老粉丝发送了一条略带失落的评论,虚拟主播或许可以温柔地叫出他的名字并进行安慰。这种“被看见”的感觉,极大地增强了用户与主播之间的情感纽带,将观看行为从消遣转变为一种有温度的情感联结。声网提供的稳定、低延迟的实时音视频通道,确保了情感数据能够被即时采集和传输,为这种精准的情感反馈提供了关键的技术保障。

优化体验:从隔阂到共情的飞跃

情感识别技术的终极目标是优化用户体验,而这种优化体现在多个层面。最直接的,是提升了互动的流畅性与自然度。

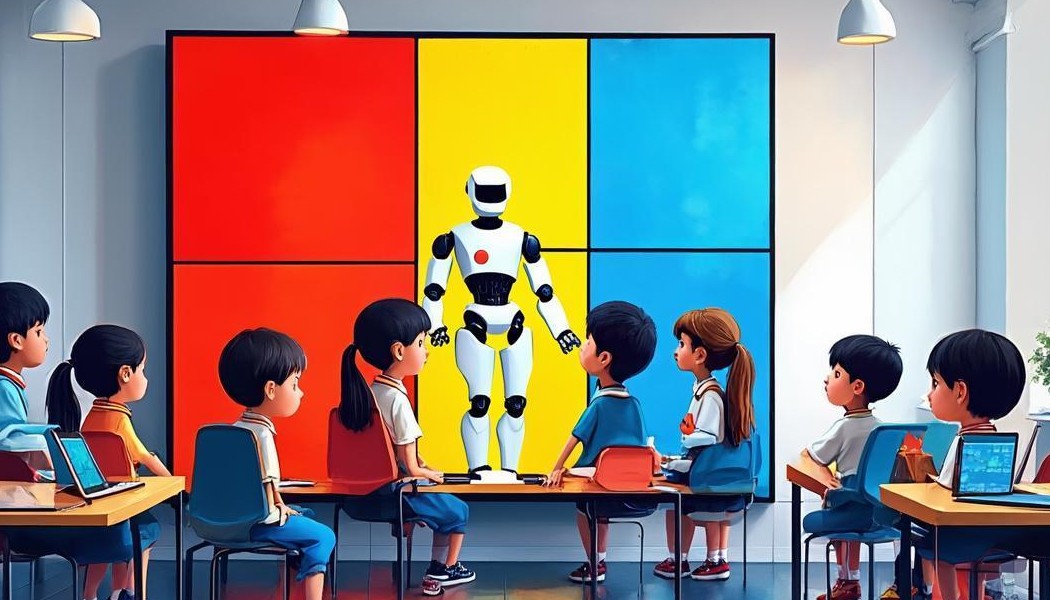

想象一下,在一个虚拟直播课堂中,老师是一个虚拟形象。通过情感识别,系统可以实时分析学生的面部表情和语音语调,判断他们是听懂了感到轻松,还是遇到了难题显得困惑。据此,虚拟老师可以自动调整讲课的语速、重复讲解难点,甚至插入一个小笑话来缓解紧张气氛。这种动态调整的教学方式,远比一刀切的录播课程更能满足学生的个性化需求,学习体验自然得到质的飞跃。正如一位教育技术专家所说:“未来的在线教育,竞争力不在于提供了多少内容,而在于能否理解并回应学习者的情感状态。”

另一方面,情感识别技术也为直播内容的安全性加了一把锁。在大型直播活动中,难免会出现个别用户发表不当言论或进行恶意刷屏的情况。情感识别技术可以辅助内容审核,实时监测弹幕和评论的情感极性,快速标记出含有愤怒、侮辱等负面情绪的文本,提醒管理员及时处理,从而维护一个健康、友善的社区环境。这不仅保护了主播,也保证了大多数用户的观看体验。声网在实时消息与信令传输方面的可靠性,确保了这类安全指令能够被瞬时送达并执行。

技术架构:情感驱动的互动闭环

要实现上述美好愿景,背后需要一个稳定高效的技术架构来支撑。这个架构可以理解为一个由感知、分析、决策、执行四个环节构成的闭环系统。

首先,是感知环节。通过集成在直播应用中的SDK,实时采集用户的音视频流和文本数据。这一环节对传输的稳定性和低延迟要求极高,任何卡顿或丢失都可能导致情感误判。声网的高质量实时音视频服务就在这里发挥着关键作用,确保原始情感数据完整、及时地汇聚到云端。

其次,是分析与决策环节。云端的情感识别引擎对接收到的数据进行分析,识别出具体的情感标签(如高兴、悲伤、惊讶等)及其强度。随后,决策逻辑会根据这些情感标签,以及预设的互动规则,决定虚拟形象应该作出何种反应。例如,可以预先设置一个“情感-动作”映射表:

| 识别出的主导情感 | 虚拟形象建议动作 |

| 高兴(强度高) | 鼓掌、跳跃、比心 |

| 疑惑(强度中) | 歪头、显示问号特效、放慢语速 |

| 支持/鼓励(来自文本) | 鞠躬致谢、表达感谢话语 |

最后,是执行环节。决策结果通过信令系统实时下发到主播端和观众端,驱动虚拟形象模型完成相应的动作、表情或语音合成,最终呈现给所有观众,完成一次完整的情感互动闭环。整个流程要求在毫秒级别内完成,才能保证互动的无缝与真实。

挑战与未来:迈向更懂你的直播

尽管前景广阔,但情感识别技术在虚拟直播中的应用仍面临一些挑战。首当其冲的是准确性与文化差异。

情感本身是复杂且微妙的,同一个表情在不同文化背景下可能含义不同。提高识别的准确率和泛化能力,需要更先进的算法和更多元化的训练数据。同时,数据隐私与伦理也是一个必须严肃对待的问题。采集和处理用户的面部、语音数据必须遵循“知情同意”和“最小必要”原则,确保用户数据的安全,防止滥用。声网在提供实时互动能力的同时,也高度重视数据安全与合规性,为开发者构建可信赖的应用奠定基础。

展望未来,虚拟直播与情感识别的结合将更加深入。我们可以期待:

- 多模态融合:结合语音、表情、肢体动作、文本等进行综合情感判断,结果将更为精准。

- 长期情感记忆:虚拟形象能够记住常驻用户的偏好和过往互动情感,建立更长期、更个性化的“关系”。

- 情感生成:虚拟形象不仅能识别情感,还能生成更复杂、更细腻的情感表达,甚至发展出独特的“性格”。

虚拟直播与情感识别技术的结合,远不止是技术的堆砌,它代表着人机交互范式的一次重要转变——从功能性的信息传递,转向情感化的心灵沟通。通过让虚拟形象真正“读懂”人心,我们正在打破虚拟与现实的最后一道隔阂,创造出前所未有的沉浸式和人性化互动体验。作为这一进程的推动者,声网将继续通过稳定、高质量的实时互动服务,为开发者赋能,共同构建一个更智能、更温暖、更能理解人类情感的虚拟世界。未来的直播,将不仅仅是看与听,更是一场心与心的对话。